ailia SDK 1.2.4をリリース

クロスプラットフォームで利用できるGPU対応の高速AI推論フレームワークであるailia SDKのバージョン1.2.4のご紹介です。ailia SDKについてはこちらをご覧ください。

cuDNN8対応

cuDNN8とTensorCoreに対応しました。cuDNN8とTensorCoreに対応したことで、NVIDIAのGPU環境でより高速な推論が可能になります。

Windowsではailia_cuda_7.dllとailia_cuda_8.dllが、Linuxではailia_cuda-7.soとailia_cuda-8.soが含まれ、ailia SDKがインストールされている環境に応じてcuDNN7とcuDNN8を自動的に選択します。

Windowsで使用する場合は、CUDA TOOLKIT 11(cuda_11.1.0_456.43_win10.exe)とcuDNN 8.0.3 for CUDA 11.0(cudnn-11.0-windows-x64-v8.0.3.33.zip)をインストールし、Pathにcudnn/cuda/binを、CUDA_PATHにNVIDIA GPU Computing Toolkit/CUDA/v11.0を通します。

WinndowsのRTX2080でcuDNN7とcuDNN8を比較すると、FP32では性能差はあまりありませんが、FP16ではResNet50で30%程度高速になります。

ailia SDKでは、ユーザの環境に特別なライブラリをインストールしなくても使用できるVulkanによる推論と、限界までGPUパフォーマンスを引き出すcuDNNによる推論の両方に対応しています。

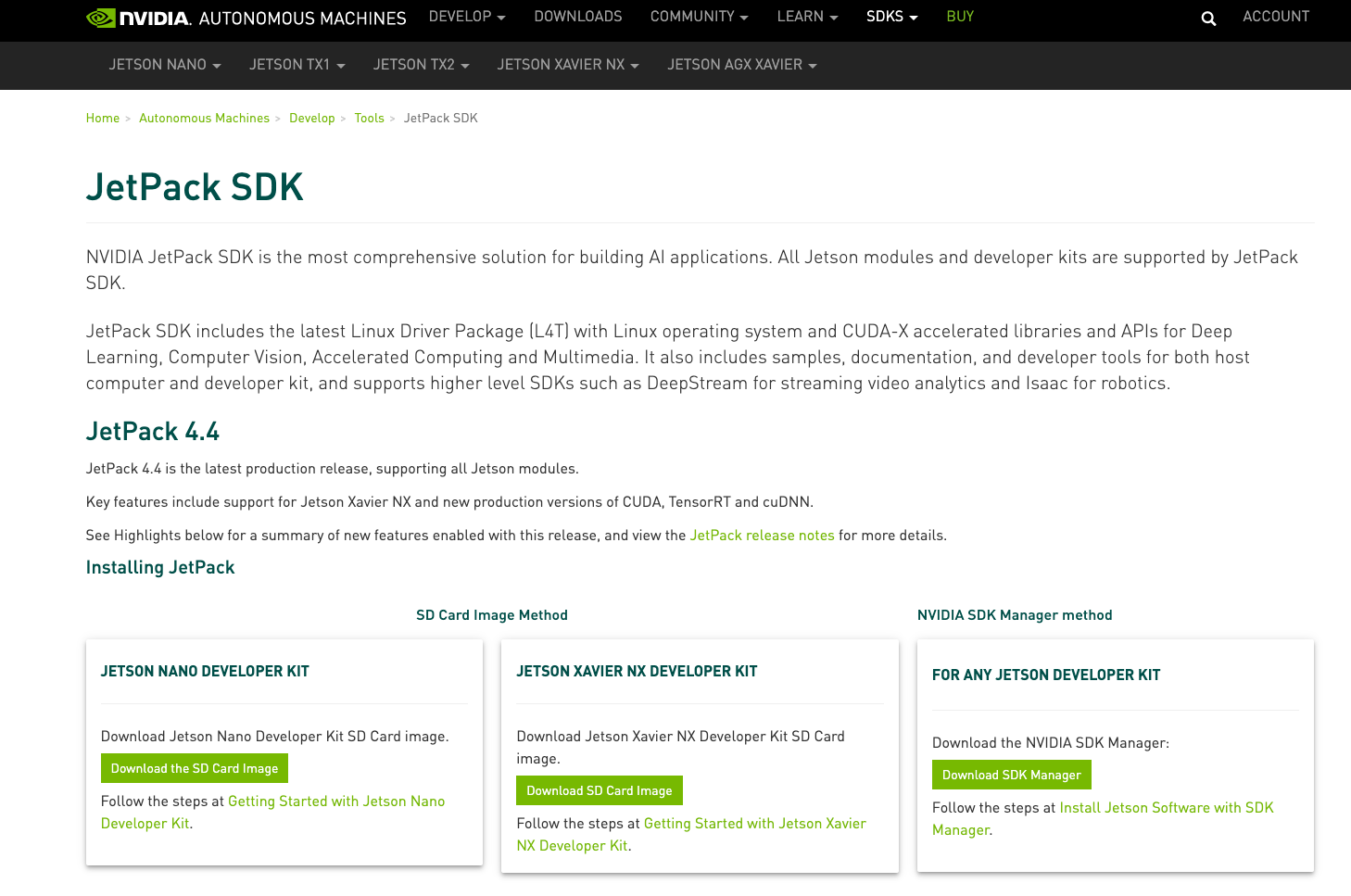

Jetpack4.4対応

Jetsonにおいても、従来のJetpack4.2 + cuDNN7に加えて、Jetpack4.4 + cuDNN8による推論に対応しました。Jetpack4.4においては最初からcuDNN8がインストールされているため、特に設定は不要です。

https://developer.nvidia.com/embedded/jetpack

CPU高速化の強化

AVX実装に加えてSSE2実装を追加しました。また、Deconvolutionを含む各種レイヤーのCPU実装の高速化を行いました。

Softplusレイヤーへの対応

新たにYOLOv4で使用されているSoftplusレイヤーに対応しました。

AndroidのOpenCLバックエンドのサポート終了

Vulkanバックエンドが十分に高速になったことに伴い、AndroidのOpenCLバックエンドのサポートを終了しました。今後、OpenCLバックエンドはLinuxおよび組み込み機器向けの提供となります。

opset=11対応(先行実装)

先行実装としてu2netで使用している範囲に限定されますが、opset=11に対応しました。これにより、PytorchのResizeの仕様に合わせたスケーリングが可能になり、u2netなど、Resizeを使用するモデルの精度が改善します。今後、opset=11のカバレッジを上げていく予定です。

5次元入力と3D Convolution対応(先行実装)

動画のアクション検出モデル(MARSやST-GCNなど)への対応を目的として、5次元以上の入出力に対応したAPIを追加しました。また、先行実装として3D ConvolutionのCPUとCUDA実装を追加しました。

新しく対応したモデル

ailia SDK 1.2.4で新しく対応したモデルは下記になります。

Council gan : 画像のドメイン変換モデル

Pytorch-ZOO GNet : 画像の生成モデル

MiDaS : 画像から深度情報を推定するモデル

MARS : 動画からアクションを検出するモデル

無償評価版

ailia SDK 1.2.4はailia SDKの公式サイトから無償評価版をダウンロード可能です。Windows、Mac、Linux、iOS、Android、Jetsonの各環境でailia SDKの評価が可能です。

アイリア株式会社はAIを実用化する会社として、クロスプラットフォームでGPUを使用した高速な推論を行うことができるailia SDKを開発しています。アイリア株式会社ではコンサルティングからモデル作成、SDKの提供、AIを利用したアプリ・システム開発、サポートまで、 AIに関するトータルソリューションを提供していますのでお気軽にお問い合わせください。

ailia Tech BLOG

ailia Tech BLOG