ailia SDK 1.2.3をリリース

クロスプラットフォームで利用できるGPU対応の高速AI推論フレームワークであるailia SDKのバージョン1.2.3のご紹介です。ailia SDKについてはこちらをご覧ください。

ailia SDKのバージョン1.2.3をリリースしました。主な変更点をご紹介します。

CPU推論の大幅な高速化

AVX2およびNEON向けの最適化を行い、CPUによる推論速度が大幅に向上しました。例えば、Android環境のYOLOv3 tinyでは、従来の4倍の速度で推論が可能となります。これにより、GPUパフォーマンスが低いローエンドのSoCにおいてもAIモデルの実装が可能になります。

省メモリモードの追加

推論時に動的にテンソルを開放することで、メモリ使用量を抑えた推論が可能になりました。これにより、メモリ資源の限られた環境で大きなモデルを動作させることが可能になります。

省メモリモードを使用するには、get_memory_mode APIで取得したメモリモードをモデルオープン時に与えます。

モデルサポートの強化

新たに、ReduceL1、ReduceL2、Whereに対応し、EfficientNet、MaskRCNN、M2Det、Deepsortに対応しました。

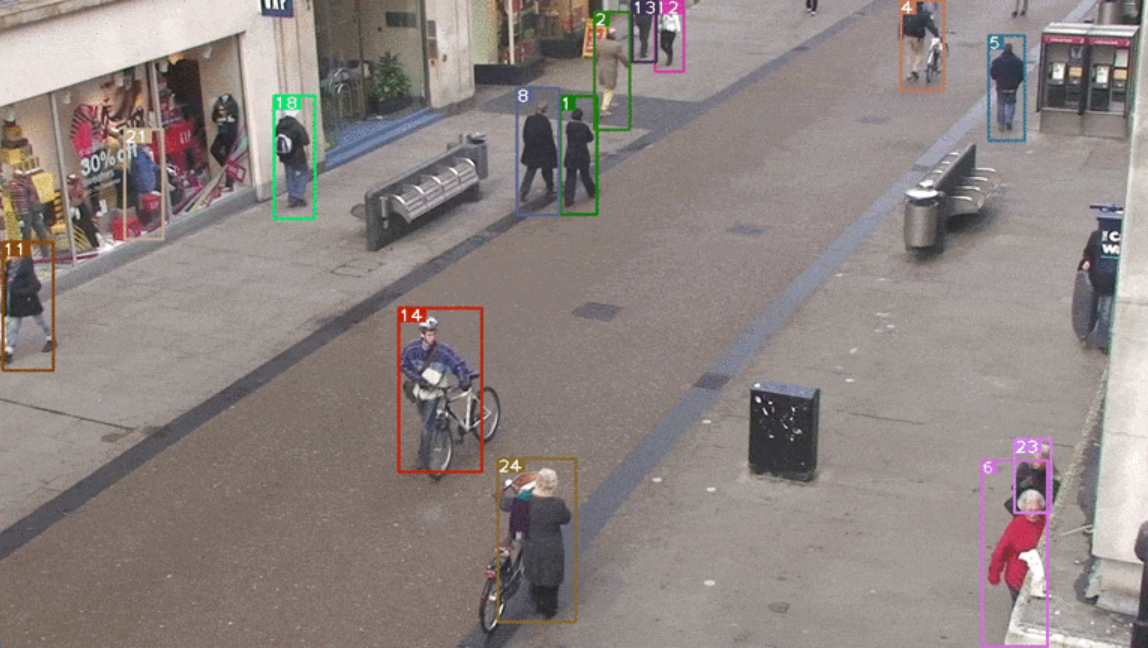

TownCentreXVID.aviに対するDeepsortの処理結果(TownCentreXVID.aviの出典:http://www.robots.ox.ac.uk/~lav/Research/Projects/2009bbenfold_headpose/project.html)

LinuxのVulkan対応

LinuxにおいてVulkanによるGPU推論に対応しました。Vulkanのライブラリは下記のコマンドでインストールすることができ、Vulkanのインストールされた環境でGPUを使用した高速推論が可能になります。

apt install libvulkan1

Slack Communityの開設

ailia SDKを含むAI全般の情報共有の場としてSlack Communityを開設しました。下記の招待リンクから、ぜひご参加ください。

アイリア株式会社はAIを実用化する会社として、クロスプラットフォームでGPUを使用した高速な推論を行うことができるailia SDKを開発しています。アイリア株式会社ではコンサルティングからモデル作成、SDKの提供、AIを利用したアプリ・システム開発、サポートまで、 AIに関するトータルソリューションを提供していますのでお気軽にお問い合わせください。

ailia Tech BLOG

ailia Tech BLOG